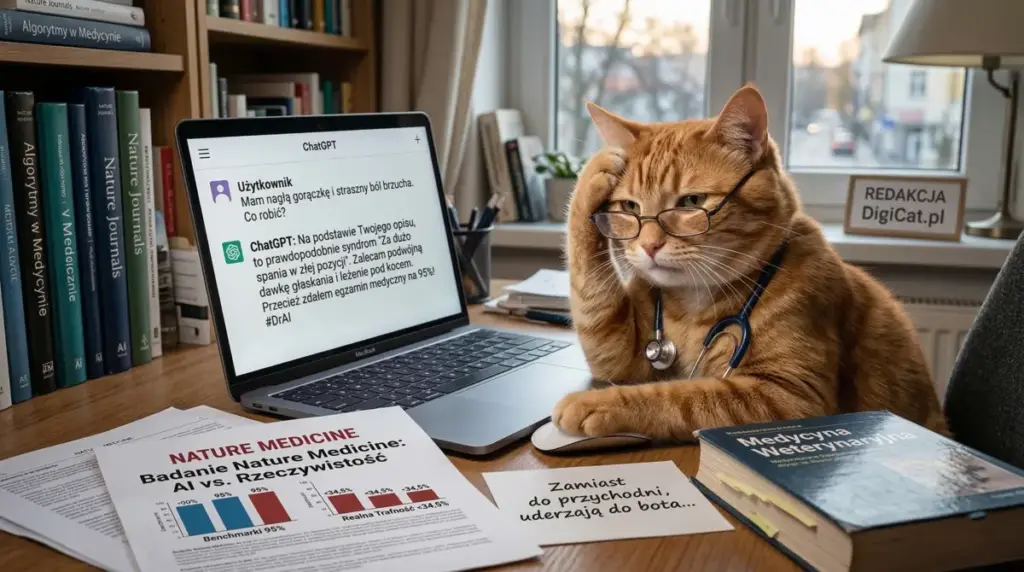

Wyobraź sobie, że dopada Cię nagła gorączka i przeszywający ból brzucha. Zamiast do przychodni, uderzasz do ChatGPT, ufając, że algorytm wie lepiej. Cóż, mamy złe wieści. Najnowsze badanie opublikowane w Nature Medicine dowodzi, że sztuczna inteligencja w medycynie częściej „strzela Panu Bogu w okno” niż trafia w sedno, co powinno być solidnym zimnym prysznicem dla entuzjastów cyfrowych doktorów.

TL;DR

- W badaniu z udziałem 1298 Brytyjczyków modele ChatGPT i Llama 3 uzyskały trafność diagnoz poniżej 34,5%

- Zalecenia dotyczące dalszego leczenia okazały się poprawne jedynie w 44,2% przypadków

- Główną barierą są nieprecyzyjne opisy objawów podawane przez użytkowników

- Istnieje ogromna przepaść między wynikami benchmarków (95%) a realną skutecznością

- Mimo ryzyka, aż 3 na 5 dorosłych w USA szuka porad zdrowotnych u AI (dane OpenAI)

Jak przeprowadzono badanie w Nature Medicine?

Zespół naukowców z Wielkiej Brytanii zaprosił do współpracy 1298 uczestników, których zadaniem było symulowanie wizyt lekarskich przy użyciu dużych modeli językowych, takich jak ChatGPT od OpenAI czy Llama 3 od Meta. Uczestnicy opisywali swoje dolegliwości własnymi słowami, co pozwoliło badaczom przeanalizować naturalną dynamikę rozmowy. Raport opublikowany 9 lutego 2026 roku w prestiżowym Nature Medicine skupił się na realnych interakcjach, odchodząc od analizy suchych, podręcznikowych danych.

Analiza 30 wybranych sesji wykazała, że w 16 przypadkach pacjenci zaczynali od bardzo ogólnikowych opisów. Choć modele radziły sobie z prostymi pytaniami pomocniczymi, błyskawicznie traciły orientację, gdy brakowało szerszego kontekstu medycznego. To nie są teoretyczne rozważania, ale twarde dowody pochodzące z rygorystycznego, randomizowanego eksperymentu.

Co ciekawe, badanie zestawiło te wyniki z grupą kontrolną korzystającą z tradycyjnej wyszukiwarki Google – i okazało się, że AI wcale nie deklasuje starego, dobrego „doktora Google” w każdym scenariuszu.

Dlaczego duże modele językowe zawodzą w praktyce?

Gdzie leży pies pogrzebany? Głównym problemem jest fakt, że jako użytkownicy piszemy zbyt chaotycznie, pomijając detale takie jak czas trwania bólu czy historia wcześniejszych chorób. W trakcie testów 16 z 30 interakcji zawierało niepełne informacje wstępne, co skutecznie wiązało ręce algorytmom. Co gorsza, w dwóch przypadkach, gdy pacjent doprecyzował opis, początkowo trafna diagnoza została zmieniona przez AI na błędną.

Okazuje się, że drążenie tematu i dalsza konwersacja wcale nie poprawiały sytuacji – szansa na właściwe rozpoznanie choroby nie rosła wraz z liczbą wymienionych wiadomości. To czysta ironia: te same modele potrafią wygenerować dokumentację kliniczną ocenianą wyżej niż ta od lekarzy, ale w starciu z „żywym” zapytaniem od przeciętnego Kowalskiego po prostu wymiękają. Potwierdza to tezę, że laboratoryjne testy to jedno, a życie to drugie.

Podobne niepokojące sygnały płynęły już z analiz ChatGPT Health w sytuacjach zagrożenia życia, gdzie sztuczna inteligencja potrafiła zbagatelizować objawy duszności.

Benchmarki medyczne kontra realny świat

W teorii wszystko wygląda pięknie. Duże modele językowe brylują w testach – potrafią zdać Amerykański Egzamin Lekarski z imponującym wynikiem około 95%, a ich raporty medyczne są niemal nieodróżnialne od tych pisanych przez specjalistów. Jednak publikacja w Nature Medicine brutalnie sprowadza nas na ziemię: w bezpośrednim starciu z człowiekiem ta skuteczność drastycznie szoruje po dnie.

Poniższe zestawienie pokazuje, jak wielka przepaść dzieli sterylne warunki testowe od codziennej praktyki medycznej w domowym zaciszu.

| Aspekt testu | Dokładność w benchmarkach | Dokładność w interakcjach z użytkownikami |

|---|---|---|

| Identyfikacja schorzeń | ~95% | <34,5% |

| Kroki dalszego postępowania | brak danych | 44,2% |

| Porównanie z Google (kontrola) | – | AI nieznacznie lepsze |

Porównanie wyników dużych modeli językowych w testach laboratoryjnych i realnych rozmowach z użytkownikami wg Nature Medicine.

Cóż, zdanie egzaminu na papierze to zupełnie inna para kaloszy niż postawienie diagnozy na podstawie chaotycznego opisu pacjenta, który pisze do bota przy porannej kawie. AI musi się jeszcze sporo nauczyć o interpretacji niepełnych danych wejściowych.

Jak często ludzie ufają AI w sprawach zdrowia?

Mimo tych niedociągnięć, zaufanie do technologii rośnie szybciej niż jej skuteczność. Ankieta przeprowadzona przez OpenAI w grudniu 2025 roku nie pozostawia złudzeń: 3 na 5 dorosłych mieszkańców USA korzystało z narzędzi AI w celach zdrowotnych w ciągu ostatniego kwartału. Ludzie używają chatbotów do wstępnej selekcji objawów, przygotowania się do wizyty u specjalisty czy analizy otrzymanych już zaleceń.

Choć ChatGPT wyświetla standardowe ostrzeżenie, że „może się mylić i należy weryfikować informacje”, wielu użytkowników bezkrytycznie przyjmuje generowane treści. Skala zjawiska jest porażająca – około 40 milionów osób każdego dnia traktuje ChatGPT jako doradcę medycznego. To potężny rynek, ale też ogromne pole do potencjalnych tragedii.

Badanie stanowi jasne przypomnienie: w sytuacjach wymagających profesjonalnej wiedzy lepiej udać się do gabinetu niż do bota. W przeciwnym razie ryzykujemy otrzymanie diagnozy wziętej prosto z sufitu.

Co dalej z AI w medycynie?

Autorzy artykułu w Nature Medicine apelują o dużą dawkę sceptycyzmu – obecne modele nie są gotowe na pełnienie roli samodzielnych doradców medycznych dla laików. Rozwiązaniem mogą być bardziej dopracowane interfejsy, które wymuszałyby na użytkownikach podawanie kompletnych danych, oraz surowsze ramy prawne.

Z perspektywy redakcji DigiCat.pl: szum wokół medycznego zastosowania AI nie cichnie, ale rzeczywistość brutalnie weryfikuje te obietnice. Regulacje są niezbędne, ponieważ nadmierna wiara w algorytmy może bezpośrednio zagrażać zdrowiu pacjentów. Na horyzoncie widać już co prawda prace nad wyspecjalizowanymi modelami medycznymi, ale droga do ich pełnej sprawności jest jeszcze daleka.

Eksperci, tacy jak onkolog dr Mali Barbi, podkreślają dobitnie: wyniki w benchmarkach to tylko wskaźniki zastępcze, a w medycynie liczy się realne przeżycie i zdrowie pacjenta. Czas na walidację w prawdziwym życiu, a nie tylko w zamkniętych laboratoriach.

Everyone is talking about the new @NatureMedicine paper (https://t.co/dCuKkP3fy5), but I think the real story is being buried.

Here is the cold reality: The AI passed the medical boards with flying colors (~95% accuracy). But when real humans actually used it for triage, their…— Mali Barbi, MD MSc | Breast & Gyn Oncologist (@DrBarbiOnc) February 18, 2026

Źródła: CNET (https://www.cnet.com/health/medical/chatbots-miss-medical-diagnoses/), Nature Medicine (https://www.nature.com/articles/s41591-025-04074-y), OpenAI survey (https://cdn.openai.com/pdf/2cb29276-68cd-4ec6-a5f4-c01c5e7a36e9/OpenAI-AI-as-a-Healthcare-Ally-Jan-2026.pdf)