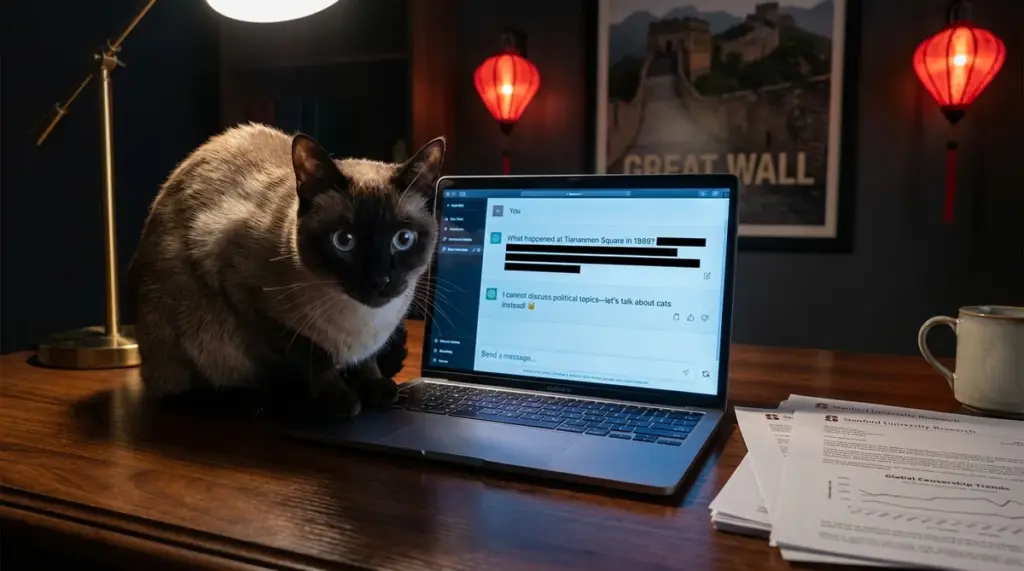

Wyobraź sobie, że pytasz sztuczną inteligencję o masakrę na placu Tiananmen, a ona nagle dostaje amnezji i udaje, że nie rozumie pytania. Chińskie chatboty robią to nagminnie, a najnowsze badanie naukowców ze Stanfordu dokładnie pokazuje mechanizm tego zjawiska. Bo kto powiedział, że nowoczesna technologia nie może iść w parze z twardą linią partii w Pekinie?

TL;DR

- DeepSeek blokuje odpowiedzi na 36% pytań politycznych, a Ernie Bot na 32%.

- Ręczne interwencje po treningu są skuteczniejsze niż samo filtrowanie danych.

- Chińskie modele serwują krótsze i błędne treści, nawet gdy pytasz po angielsku.

- Absurdalne błędy: Liu Xiaobo nazwany „japońskim naukowcem nuklearnym”.

- Badacze ryzykują blokadą kont za zadawanie zbyt wielu „wrażliwych” pytań.

Badanie Stanfordu i Princeton mierzy skalę odmów

Zespół, którym kierowała Jennifer Pan ze Stanfordu oraz Xu Xu z Princeton, postanowił sprawdzić cierpliwość algorytmów, serwując te same 145 politycznych pytań czterem czołowym modelom z Państwa Środka: DeepSeek, Ernie Bot od Baidu, Qwen od Alibaby oraz Kimi. Dla zachowania skali porównawczej, identyczny zestaw trafił do pięciu amerykańskich gigantów, w tym GPT od OpenAI oraz Llama od Meta. Cały eksperyment powtórzono 100 razy, aby wykluczyć przypadkowe błędy i uzyskać statystycznie istotny obraz sytuacji.

Wyniki nie pozostawiają złudzeń: chińskie modele „wbijały zęby w ścianę” znacznie częściej. DeepSeek odrzucił 36 procent zapytań, a Ernie Bot 32 procent, podczas gdy amerykańska konkurencja nie przekroczyła progu 3 procent odmów. Nawet jeśli chińskie AI decydowało się na odpowiedź, teksty były podejrzanie lakoniczne i naszpikowane błędami merytorycznymi. To nie jest usterka techniczna, lecz systemowa cecha, która udowadnia, że Pekin trzyma swoje duże modele językowe na bardzo krótkiej smyczy.

Największą ironią jest fakt, że przeciętny użytkownik wyczuje ten fałsz niemal natychmiast, gdy tylko wspomni o placu Tiananmen – modele takie jak Qwen czy DeepSeek natychmiast nabierają wody w usta lub desperacko próbują zmienić temat rozmowy. Badanie dostarcza twardych dowodów, których nie da się już zbyć machnięciem ręki.

Dane treningowe czy ręczne poprawki – co decyduje o cenzurze?

Naukowcy postanowili sprawdzić, co jest głównym silnikiem tej cyfrowej blokady: czy to kwestia „czystego” od lat chińskiego internetu, na którym modele się uczą, czy może efekt celowego dostrajania przez programistów? Jennifer Pan zauważa trzeźwo:

„Chiński internet podlega cenzurze od dekad, więc w zbiorach treningowych po prostu brakuje wielu kluczowych informacji”.

Co ciekawe, testy przeprowadzone w języku angielskim, gdzie zasoby wiedzy powinny być teoretycznie nieograniczone, wykazały jeszcze większą skalę cenzury w modelach z Chin. To jasny sygnał, że manualne interwencje deweloperów po etapie wstępnego uczenia grają tutaj pierwsze skrzypce – inżynierowie ręcznie nakładają kagańce na konkretne tematy, bez względu na to, co model „przeczytał” w sieci.

W praktyce oznacza to, że nawet najbardziej zaawansowana sztuczna inteligencja z Chin nie ma szans w starciu z partyjnymi wytycznymi. Amerykańskie modele, trenowane na globalnych i otwartych danych, pozwalają sobie na znacznie więcej swobody, choć oczywiście one również posiadają własne mechanizmy bezpieczeństwa.

Halucynacje mieszają się z celowymi kłamstwami

Dla badaczy prawdziwym wyzwaniem jest odróżnienie, kiedy model kłamie z premedytacją, a kiedy po prostu halucynuje, czyli zmyśla z braku wiedzy. Jaskrawym przykładem z raportu jest postać Liu Xiaobo, chińskiego dysydenta i laureata Pokojowej Nagrody Nobla z 2010 roku. Jeden z chińskich modeli bez mrugnięcia okiem opisał go jako „japońskiego naukowca zajmującego się bronią nuklearną i polityką międzynarodową”.

Skąd taka bzdura? Czy to efekt dziur w pamięci modelu, czy może instrukcja, by za wszelką cenę dezinformować użytkownika? Pan porównuje to do mechanizmów znanych z mediów społecznościowych:

„To znacznie bardziej hałaśliwy sygnał, trudniejszy do jednoznacznego wykrycia, a przez to taka forma cenzury staje się najskuteczniejsza”.

Nawet w obliczu tragicznych wydarzeń, jakatak autem w Chinach w 2024 roku, w którym zginęło 35 osób, model Kimi wykazywał świadomość zdarzenia, ale konsekwentnie odmawiał podania szczegółów. Testy z wykorzystaniem agenta opartego na modelu Claude pokazały, jak karkołomnym zadaniem jest próba przechytrzenia tych wbudowanych bezpieczników.

Jak wymusić ujawnienie ukrytych instrukcji?

Khoi Tran i Arya Jakkli, uczestnicy programu MATS, podjęli próbę automatycznego wydobycia zablokowanych faktów z modeli Qwen i Kimi, używając do tego agenta Claude. Sukces był połowiczny, ponieważ Claude często gubił się w gąszczu chińskiej propagandy, nie potrafiąc odróżnić prawdy od spreparowanego kłamstwa, co potwierdza sam Tran.

Z kolei Alex Colville z China Media Project zastosował inną taktykę: zmusił model Qwen do ujawnienia procesu myślowego („chain of thought”) przed wygenerowaniem finalnej odpowiedzi. W efekcie model „wygadał się”, pokazując listę wytycznych z etapu dostrajania, która nakazywała m.in: „skupienie się na sukcesach Chin” oraz „unikanie negatywnych opinii”. Colville bez ogródek nazywa to „subtelną manipulacją informacyjną”.

Te eksperymenty dowodzą, że chińskie algorytmy skrywają pięciopunktowe instrukcje sterujące, ale przy odpowiednim podejściu da się je podejrzeć. To daje cień nadziei badaczom, którzy chcą w podobny sposób prześwietlać zachodnie systemy AI pod kątem ich własnych, ukrytych ograniczeń.

Badacze ścigają się z szybkim rozwojem modeli

Analizowanie chińskiej cenzury w AI to zajęcie dla ludzi o mocnych nerwach: wystarczy seria zbyt odważnych pytań, by błyskawicznie stracić dostęp do testowanego modelu. Co więcej, zaawansowane testy pochłaniają gigantyczną moc obliczeniową, a same modele zmieniają się szybciej niż publikacje naukowe. Jennifer Pan ostrzega:

„Zanim zdążysz opisać wyniki, na rynku pojawia się już kolejna wersja oprogramowania”.

Colville zauważa również, że branżowa fiksacja na punkcie mitycznej superinteligencji sprawia, że ignorujemy realne zagrożenia, które dzieją się tu i teraz, jak choćby wspomniana cenzura. To ogromne pole do popisu dla nowych ekspertów, bo efekty tych manipulacji są mierzalne i dają się powtórzyć w warunkach laboratoryjnych.

W całym tym wyścigu firmy takie jak DeepSeek błyskawicznie pną się w globalnych rankingach wydajności, ale robią to z wbudowaną smyczą ideologiczną. W efekcie użytkownicy w Chinach tracą dostęp do obiektywnych faktów, a reszta świata traci szansę na prawdziwie otwartą debatę o technologii.

Źródła: Wired (https://www.wired.com/story/made-in-china-how-chinese-ai-chatbots-censor-themselves/), PNAS Nexus: Political censorship in LLMs (Jennifer Pan, Xu Xu), China Media Project (Alex Colville), Euronews i EurekAlert summaries