Monopol zachodnich gigantów na najnowocześniejsze AI przeżywa trudne chwile, a chiński GLM-4.7 wchodzi na scenę jako silna, i co ważniejsze – znacznie tańsza alternatywa. Zamiast jednak wpadać w zachwyt nad samym faktem powstania nowego modelu, sprawdzamy na chłodno, jak GLM-4.7 wypada w porównaniach z GPT-5.2 i resztą stawki oraz czy warto o nim myśleć poważnie, czy to tylko ciekawostka technologiczna.

GLM-4.7 w pigułce: czym jest ten model i dlaczego o nim głośno?

GLM-4.7 pochodzi z pracowni Zhipu AI, firmy często określanej mianem chińskiego odpowiednika OpenAI, i wchodząc na rynek w późnym 2025 roku, nie zamierzał być tylko „tańszą zamiennikiem”. To flagowa konstrukcja, która od samego początku została zaprojektowana z myślą o dwóch filarach: zaawansowanym programowaniu i reasoningu (czyli zdolności do logicznego wnioskowania), co w praktyce przekłada się na konkretne wyniki w benchmarkach.

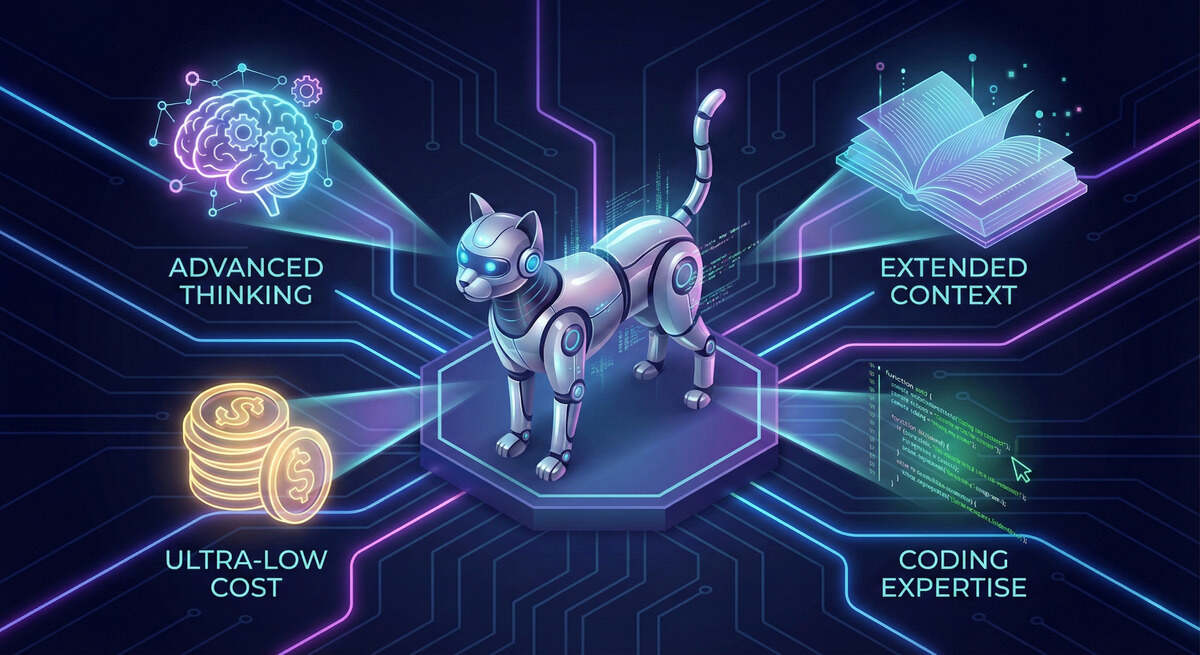

Co czyni go jednak ciekawym dla przeciętnego odbiorcy, a nie tylko dla analityków danych? Przede wszystkim specyfika działania. GLM-4.7 został wyposażony w tryb „Thinking”, który – podobnie jak w przypadku najlepszych modeli konkurencji – pozwala mu poświęcić nieco więcej czasu na „przemyślenie” zapytania przed udzieleniem ostatecznej odpowiedzi. Do tego dochodzi potężne „okno kontekstowe” (obsługujące nawet 200 tysięcy tokenów) oraz zdolność wygenerowania niezwykle długich odpowiedzi (aż do 128 tysięcy tokenów). W praktyce oznacza to, że model jest w stanie połknąć całe repozytoria kodu lub długie dokumenty i wypluć z nich sensowne wnioski. Producent kusi ponadto ceną – poprzez pakiety takie jak GLM Coding Plan, oferując dostęp do technologii za ułamek kosztów, jakie znamy z gigantów z Doliny Krzemowej. To sprawia, że GLM-4.7 to nie tylko technologiczne „czytanie w przyszłości”, ale przede wszystkim bardzo pragmatyczne narzędzie.

GPT-5.2, Claude Sonnet, Gemini i reszta stawki: z kim w ogóle GLM-4.7 walczy na rynku?

Jeśli spojrzymy na obecny krajobraz AI, trudno nie odnieść wrażenia, że to właśnie GPT-5.2 i Claude Sonnet 4.5 wyznaczają dziś standardy, do których innych mierzy. GPT-5.2 wciąż kojarzony jest z najwyższą jakością „ogólnego rozumowania” i potężnym ekosystemem OpenAI, podczas gdy Claude Sonnet 4.5 od Anthropic cieszy się renomą stabilnego, bezpiecznego i precyzyjnego partnera w codziennej pracy. Nie można też oczywiście pominąć Gemini od Google, który ze swoimi multimodalnymi zdolnościami i dostępnością stanowi solidny filar tego rynku.

W tym gronie mocarzy GLM-4.7 wchodzi nie jako kolejny uczestnik wyścigu zbrojeń, ale jako realna alternatywa, która odważnie podważa status quo. Nie walczy tylko o bycie „tańszym GPT-em”, ale stara się wskoczyć na półkę, na której dotąd królowały wyłącznie zamknięte modele amerykańskich gigantów. Pytanie brzmi: czy chiński model ma w zanadrzu coś więcej niż tylko ambicje, by zagrozić tym ugruntowanym graczom, czy jego rola ograniczy się do bycia ciekawostką technologiczną?

Jak GLM-4.7 wypada na tle innych modeli w kluczowych kategoriach?

Oto jak GLM-4.7 wypada liczebnie w starciu z czołówką w kluczowych dla użytkownika kategoriach:

Kodowanie i realne zadania (Agentic Coding)

- GLM-4.7 nie jest tu tylko „dobry” – na benchmarku SWE-bench Verified (naprawianie prawdziwych błędów z GitHuba) osiągnął wynik 73,8%, co plasuje go w absolutnej światowej czołówce.

- Co ciekawsze, w teście LiveCodeBench V6 model uzyskał 84,9%, deklasując Claude’a Sonnet 4.5, który uchodził za jednego z najlepszych asystentów programistycznych na rynku.

Myślenie i matematyka (Reasoning)

- W egzaminie HLE (Human Last Exam), sprawdzającym ogólną wiedzę i umiejętność wnioskowania, GLM-4.7 zdobył 42,8%. To wynik, który faktycznie przebił poprzedniego króla, czyli GPT-5.1.

- W matematyce (benchmark AIME 2025) chiński model poszedł jeszcze dalej, uzyskując imponujące 95,7%.

Kontekst i narzędzia

- GPT-5.2 wciąż wygrywa na długość – oferuje okno kontekstu na poziomie 400 000 tokenów. GLM-4.7 również nie jest mały, bo oferuje solidne 200 000 tokenów i może wygenerować aż 128 000 tokenów na wyjściu.

- Jeśli chodzi o obsługę narzędzi (τ²-Bench), GLM-4.7 uzyskał 87,4% (SOTA w open-source), wyprzedzając Claude’a Sonnet 4.5 (82,9%), co czyni go świetnym kandydatem do budowy złożonych agentów.

Cena – najważniejszy czynnik

- Tutaj robi się boleśnie dla konkurencji. Za 1 milion tokenów wyjściowych GLM-4.7 zapłacisz około 2,20 USD. W przypadku GPT-5.2 ta sama operacja to koszt około 14,00 USD.

- Różnica jest zatem ponad sześciokrotna. Trudno argumentować, że GPT jest zawsze „lepszy”, gdy alternatywa jest tak drastycznie tańsza, a w wielu testach dorównuje lub wygrywa.

Co te wszystkie porównania oznaczają w praktyce – dla kogo GLM-4.7 ma sens?

Wiemy już, że GLM-4.7 ma „mocne papiery” i jest znacznie tańszy od zachodniej konkurencji, ale komu tak naprawdę to służy? W świecie, gdzie cyferki w tabelkach przekładają się na realne zyski lub straty, odpowiedź jest dość jednoznaczna. Przede wszystkim zainteresują się nim programiści i zespoły developerskie, dla których budowa narzędzi opartych na AI to chleb powszedni. Tutaj chiński model ma przewagi, które trudno przeskoczyć:

- Dostępność i kontrola: jako model open-source, GLM-4.7 można hostować lokalnie (np. za pomocą popularnych narzędzi takich jak Ollama). Dla deweloperów ceniących prywatność, to istotna alternatywa dla wysyłania kodu do zamkniętych chmur.

- Cena, która boli konkurencję: pakiety takie jak GLM Coding Plan pozwalają korzystać z tego silnika za kilka dolarów miesięcznie. To drastyczna różnica w porównaniu do abonamentów rzędu 200 USD, które wciąż powszechne są w przypadku niektórych zachodnich narzędzi do kodowania.

Jeśli spojrzymy na firmy i startupy, argument jest jeszcze bardziej materialny. Skalowalność to nie tylko modne słowo, to kwestia przetrwania. Różnica w cenie tokenów – sięgająca nawet sześciokrotności na korzyść GLM-4.7 – sprawia, że wdrożenie AI staje się rentowne tam, gdzie wcześniej koszty po prostu nie miały sensu. Pozwala to wprowadzać automatyzację w miejscach, które nikt wcześniej nie chciał dotykać.

Nie ma jednak róży bez kolców. Tutaj na scenę wkracza grupa, która będzie najmniej zachwycona: duże korporacje i działy compliance. Wysłanie wrażliwych danych korporacyjnych na serwery w Chinach to dla wielu firm ryzyko nie do akceptacji, biorąc pod uwagę restrykcje takie jak GDPR czy wewnętrzne polityki bezpieczeństwa. W tym przypadku geopolityka może przeważyć nad technicznymi osiągami, a „tańszy” model może okazać się najdroższym błędem.

Co ze zwykłym Kowalskim? Prawdopodobnie nawet nie dowie się, że pod maską jego ulubionej aplikacji do tworzenia prezentacji czy pisania kodu pracuje model z Chin. I w sumie to w porządku – skorzysta na lepszej jakości i niższych cenach usługi, niezależnie od tego, czy serwer stoi w San Francisco, czy w Pekinie.

GLM-4.7 a reszta świata – kto powinien się bać, a kto może spać spokojnie?

Gdy patrzymy na tę sytuację z szerszej perspektywy, widać wyraźnie, że GLM-4.7 to nie jest chwilowa ciekawostka, ale sygnał ostrzegawczy dla całej branży. Warto jednak odróżnić faktyczny wpływ na rynek od medialnego szumu i przyjrzeć się, kto tak naprawdę powinien zacząć się niepokoić.

- Kto powinien bać się GLM-4.7? Przede wszystkim firmy, które przez ostatnie lata budowały swoje modele biznesowe na sprzedaży dostępu do drogich, zamkniętych modeli (API) bez oferowania wyraźnej przewagi jakościowej. Chiński konstruktor udowodnił, że można dostarczyć „flagową” jakość kodowania i reasoningu za ułamek ceny – to bezpośrednie uderzenie w marże gigantów, którzy dotąd czuli się bezpiecznie na swoim tronie.

- Kto może spać spokojnie? Zdecydowanie ci gracze, którzy zainwestowali w ekosystemy i integracje. OpenAI z GPT-5.2 czy Google z Gemini nie są tylko „dostawcami modeli” – są platformami, które są głęboko wbudowane w workflow milionów użytkowników i setek innych aplikacji. Wystarczy spojrzeć na GPT Store, rozszerzenia do przeglądarek czy integracje w systemach operacyjnych.

Dla przeciętnego użytkownika wygoda użytkowania i dostępność w narzędziach, które już zna, często ważniejsze są niż abstrakcyjny wynik w benchmarku czy niższa cena za milion tokenów.

GLM-4.7 wymusza na rynku pewnego rodzaju „sanację cenową”, pokazując, że AI nie musi kosztować majątku. Jednak odebranie kilku procent udziałów w rynku czy zmuszenie konkurencji do obniżek cen to nie to samo co „zdetronizowanie” gigantów. OpenAI, Anthropic i Google mają wciąż gigantyczne zasoby danych, infrastruktury, a co ważniejsze – zaufanie klientów wypracowane przez lata. GLM-4.7 to w tym momencie ten „gówniany” samochód, który jest w stanie wyprzedzić Porsche na prostej drodze – to może sprawiać przyjemność i dawać nadzieję, ale w prawdziwym wyścigu technologicznym liczy się też jakość opon (ekosystemu) i doświadczenie kierowcy (intuicji użytkownika). Zachodnie firmy mogą spać spokojnie, ale muszą przestać mrugać – rywalizacja właśnie weszła w nową, znacznie bardziej agresywną fazę.

Jak zacząć przygodę z GLM-4.7? Gdzie szukać dostępu?

Wszystko brzmi pięknie na papierze, ale jak to przekuć w działanie i sprawdzić, czy chiński model faktycznie działa w Twoim przypadku? Na szczęście Zhipu AI nie utrudnia życia i udostępniło swoje dzieło na kilku frontach, dzięki czemu nie potrzebujesz zaawansowanej wiedzy technicznej, by zacząć eksperymentować.

- Oficjalna brama: najprostszą i najbardziej bezpośrednią drogą jest wizyta na platformie z.ai. Znajdziesz tam webowy interfejs chatowy (czyli klasyczne okno konwersacji) oraz dostęp do API dla deweloperów. To jest „źródło”, z którego wszystko płynie – zanim model trafi na inne platformy, trafia tam.

- Agregatory – OpenRouter: jeśli nie masz ochoty na rejestrację w kolejnym serwisie i wolisz mieć wszystko w jednym miejscu, sięgnij po OpenRouter. To taki „marketplace” modeli, gdzie w jednej lokalizacji masz dostęp do GLM-4.7, GPT-5.2, Claude’a i wielu innych. Wystarczy jeden klucz API, by swobodnie przeskakiwać między modelami i testować, który akurat najlepiej pasuje do Twojego zadania.

- Narzędzia dla twórców: jeśli kodujesz w VS Code, warto rzucić okiem na rozszerzenia takie jak Cline czy Roo Code. Wspierają one GLM-4.7 (często w ramach wspomnianego GLM Coding Plan) i pozwalają na płynną integrację modelu z Twoim ulubionym środowiskiem pracy.

- Lokalnie (Ollama): Dla tych, którzy cenią prywatność ponad wszystko, opcją jest Ollama. Można ściągnąć model na swój własny komputer i testować go offline. To idealne rozwiązanie dla waryjnych – Twoje dane nie opuszczają dysku, a Ty masz w pełni funkcjonalnego asystenta AI.

To właściwie tyle. Droga do świata zaawansowanego AI wciąż domkniętym przez wielkie korporacje, przestała być wyboista. Warto więc poeksperymentować, zanim Twoja konkurencja zrozumie, że nowa era tańszego, ale potężnego kodowania już się zaczęła.

Ten artykuł powstał w 99% przy użyciu modelu GLM-4.7.

Źródła:

- Dokumentacja techniczna i przewodniki GLM-4.7 (Z.AI) https://z.ai

- Porównanie modeli i benchmarki (LLM Stats, LiveCodeBench, HLE) https://llm-stats.com

- Przewodnik migracji i specyfikacja GLM-4.7 (Docs.Z.AI) https://docs.z.ai