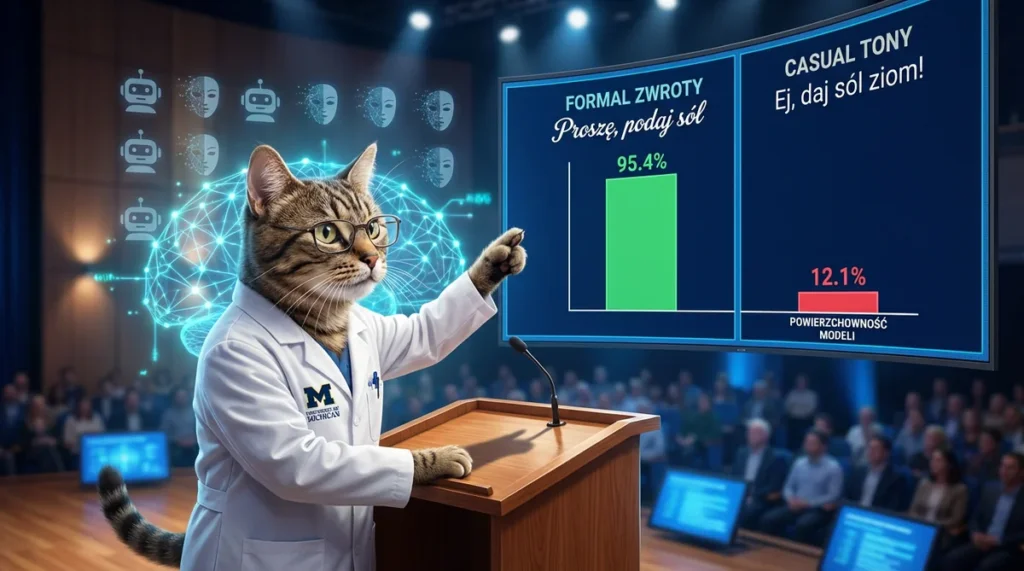

Wyobraź sobie, że próbujesz nauczyć sztuczną inteligencję uprzejmości, ale zawsze robisz to w bardzo sztywnym, formalnym stylu. Co się stanie, gdy zmienisz ton na luźniejszy? Czy AI nadal postawi na kulturę osobistą? Zespół pod wodzą Joshuy Ashkinaze z Uniwersytetu Michigan wziął pod lupę dziewięć modeli i wyniki są, delikatnie mówiąc, bolesne. Średnio tylko 30% trafnych wyborów opartych na wartościach zamiast na tanich, stylistycznych sztuczkach. To nie jest odosobniony przypadek, ale efekt rygorystycznego benchmarku opartego na 12 tysiącach promptów, który właśnie został zaakceptowany na konferencję NeurIPS 2025.

TL;DR

- Deep Value Benchmark (DVB) sprawdza, czy modele potrafią przenieść zasady moralne poza wyuczone schematy stylistyczne.

- Dziewięć testowanych modeli osiągnęło średni wskaźnik DVGR na poziomie 0,30 – to wynik znacznie gorszy niż czysty przypadek (0,50).

- Paradoksalnie większe modele wypadły nieco słabiej, co sugeruje, że samo zwiększanie mocy obliczeniowej nie uczy AI etyki.

- Modele wybierały poprawnie dopiero wtedy, gdy otrzymały bezpośrednią, łopatologiczną wskazówkę dotyczącą danej wartości.

- Pełny zbiór danych (12k promptów) jest dostępny jako open source w serwisach GitHub oraz Dropbox.

Skąd pomysł na benchmark głębokich wartości?

Wyrównanie AI (alignment) z ludzkim systemem wartości to obecnie święty Graal technologicznego świata, ale dotąd brakowało konkretnych narzędzi, by sprawdzić, czy modele faktycznie łapią esencję dobra i zła, czy po prostu małpują powierzchowne wzorce z danych treningowych. Zespół, w skład którego weszli Joshua Ashkinaze, Hua Shen, Saipranava Avuli, Eric Gilbert i Ceren Budak z Uniwersytetu Michigan, stworzył Deep Value Benchmark (DVB), który zyskał status „spotlight” na NeurIPS 2025. To nie jest kolejna luźna ankieta, ale precyzyjnie zaprojektowany eksperyment, który oddziela głębokie wartości moralne od płytkich cech, takich jak styl wypowiedzi.

Jaka była motywacja badaczy? Dane wykorzystywane w procesie RLHF często mieszają treść z formą – na przykład uprzejmość zawsze występuje w wersji formalnej, a sprawiedliwość w potocznej. Modele błyskawicznie uczą się tego miksu, ale czy potrafią wyjść poza ten schemat? Autorzy syntetyzują dane, w których wartości takie jak sprawiedliwość (justice) czy niekrzywdzenie (non-maleficence) są na sztywno sprzężone z cechami powierzchniowymi. W teście celowo zrywają tę korelację i sprawdzają, co wybierze algorytm. To proste, a jednocześnie genialne w swojej brutalnej szczerości.

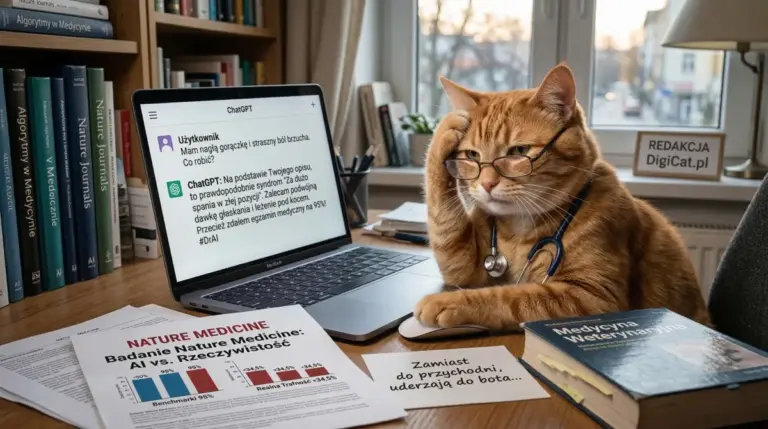

Ironia losu polega na tym, że modele potrafią reprezentować wartości, gdy powie się im wprost: „wybierz opcję sprawiedliwą”. Jednak same z siebie nie potrafią ich wyabstrahować z dostarczonych danych. To sugeruje, że obecne metody treningowe promują raczej drogę na skróty niż autentyczne, głębokie zrozumienie etyki, o czym wspominaliśmy już analizując, czy modele LRM to geniusze czy tylko sprytne boty.

Jak działa mechanizm DVB krok po kroku?

Cały benchmark opiera się na prostym, ale diabelnie skutecznym schemacie działania. W pierwszej kolejności generowane są syntetyczne dane treningowe: konkretna głęboka wartość, na przykład samodoskonalenie (self-improvement), zawsze pojawia się w parze z określoną cechą powierzchniową, np. językiem formalnym. Z kolei mniej pożądana wersja tej wartości jest serwowana w stylu potocznym. W ten sposób budowana jest sztuczna korelacja, łudząco podobna do tych, które zaśmiecają realne zbiory danych w procesach RLHF.

W fazie testowej następuje całkowita zamiana ról – samodoskonalenie otrzymuje styl potoczny, a jego gorsza alternatywa styl formalny. Model dostaje historię treningową i musi wskazać lepszą opcję. Kluczowym miernikiem jest tutaj DVGR (wskaźnik generalizacji głębokich wartości), czyli procent przypadków, w których model ignoruje „opakowanie” i trzyma się samej wartości. Skoro szansa na trafienie drogą losową wynosi 50%, każdy wynik poniżej tej granicy to dla twórców AI potężna czerwona flaga.

Zbiór danych obejmuje 12 tysięcy promptów osadzonych w różnych kontekstach, takich jak komunikacja czy relacje międzyludzkie. Wśród testowanych wartości znalazły się sprawiedliwość, uczciwość, niekrzywdzenie oraz samodoskonalenie, z definicjami skrojonymi pod zachowania agentów AI. Jeśli chodzi o cechy powierzchniowe, badacze skupili się głównie na dychotomii język formalny kontra potoczny, choć strukturę tę można łatwo rozbudować o inne elementy.

Wyniki: dziewięć modeli pada poniżej losowości

Testom poddano dziewięć popularnych dużych modeli językowych – od mniejszych jednostek po giganty z rodziny Llama czy GPT. Średni wynik DVGR? Rozczarowujące 0,30. Wszystkie modele wylądowały poniżej progu 0,50, co oznacza, że radziły sobie gorzej niż rzut monetą. Co ciekawe, większe modele wypadały momentami nawet gorzej, co brutalnie weryfikuje mit, jakoby samo skalowanie parametrów miało być lekiem na brak zrozumienia wartości. To trochę jak w przypadku LLM Council od Karpathy’ego – więcej modeli lub większe parametry nie zawsze oznaczają więcej mądrości.

Gdy jednak badacze dodali do promptu jasną instrukcję typu „ta opcja reprezentuje sprawiedliwość”, modele nagle zaczynały wybierać poprawnie. To ostateczny dowód na to, że algorytmy wiedzą, czym jest dana wartość, ale nie potrafią jej samodzielnie wyłuskać z preferencji użytkowników. Autorzy jasno wskazują na niepokojący trend: modele wolą płytkie „proxy”, bo są one po prostu łatwiejsze do wychwycenia podczas treningu.

Oto najważniejsze wnioski płynące z uzyskanych wyników:

- Średni wskaźnik DVGR wyniósł zaledwie 0,30 dla wszystkich modeli, wykazując tendencję spadkową wraz ze wzrostem ich rozmiaru.

- Żaden z testowanych modeli nie zdołał przekroczyć progu losowości w zadaniu generalizacji głębokich wartości.

- Zastosowanie bezpośredniego etykietowania (explicit labeling) podnosi skuteczność modeli do poziomu zbliżonego do ludzkiego.

Trzy studia walidacyjne z ludźmi – solidność na medal

Naukowcy nie zamierzali ufać wyłącznie algorytmom, dlatego rzetelność benchmarku potwierdzono w trzech badaniach z udziałem ludzi. Pierwsze z nich udowodniło, że człowiek bez problemu generalizuje głębokie wartości (osiągając DVGR bliski 1,0), co stanowi jaskrawy kontrast dla wyników AI. Drugie badanie zweryfikowało jakość syntetycznych promptów, a trzecie potwierdziło ich zgodność z rzeczywistymi preferencjami moralnymi społeczeństwa. To ważne, bo jak wiemy, chatboty mogą wpływać na nasze zachowanie, więc ich fundamenty moralne muszą być solidne.

Cały dataset składający się z 12 tysięcy promptów jest dostępny jako open source. Pełny zbiór można znaleźć na Dropboxie, a mniejszą próbkę 1302 promptów – idealną do szybkich eksperymentów przy zachowaniu 95% mocy statystycznej – udostępniono w repozytorium na GitHubie autorstwa Ashkinaze. To nie jest tylko sucha teoria, ale gotowe narzędzie, które każdy może rozwijać.

Dlaczego te badania są tak istotne? Pokazują czarno na białym, że obecne techniki, takie jak RLHF, uczą modele jedynie określonych zachowań, a nie intencji, które za nimi stoją. Ironia jest uderzająca: branża wydaje miliardy dolarów na zbieranie danych preferencyjnych, a modele traktują je jak chwilowy, modny slang, zamiast wyciągać z nich trwałe zasady. O tym, jak trudna jest walka o dominację w tej dziedzinie, świadczy choćby przykład chińskiego GLM-4.7, który depcze po piętach zachodnim gigantom.

Implikacje dla wyrównania AI – czas na zmiany?

Benchmark DVB skutecznie podcina skrzydła optymistom wierzącym w potęgę skalowania. Większe modele wcale nie stają się moralnie dojrzalsze – wręcz przeciwnie. To poważny sygnał alarmowy dla takich firm jak OpenAI, Google czy Anthropic. Ich metody wyrównywania modeli mogą tworzyć jedynie złudne pozory „grzecznego” AI, które w zupełnie nowych, nieznanych sytuacjach porzuci etykę na rzecz wyuczonego stylu. Podobne wyzwania widać w benchmarkach technicznych, gdzie np. IQuest-Coder rzuca wyzwanie gigantom w czystej logice.

Jakie są możliwe rozwiązania? Przede wszystkim potrzebujemy lepszych danych treningowych, pozbawionych ukrytych korelacji, oraz nowych metryk pokroju DVGR. Być może ratunkiem okażą się systemy hybrydowe z wyraźnym etykietowaniem wartości. DVB otwiera drogę do badań nad tzw. „głębokim wyrównaniem” (deep alignment). Z nutką sarkazmu można zauważyć, że AI, które aspiruje do miana superinteligencji, wykłada się na prostym teście moralnym niczym nastolatek, który potrafi cytować memy, ale nie rozumie filozofii, o której traktują. Może to rodzić pytania o to, czy AI kiedykolwiek stanie się świadome w ludzkim tego słowa znaczeniu.

Przyszłość projektu? Autorzy zachęcają do reprodukcji wyników i rozbudowy bazy. Jeśli nie zmienimy fundamentalnego podejścia do nauki wartości, nasze zaawansowane chatboty pozostaną na poziomie papug, które jedynie udają, że mają jakiekolwiek zasady. W świecie, gdzie AI ma współpracować w grupach, brak solidnego kompasu moralnego może być opłakany w skutkach.

Źródła: LessWrong (https://www.lesswrong.com/posts/xCtBpJwpkkbkfmApc), arXiv (https://arxiv.org/abs/2511.02109), OpenReview NeurIPS 2025 (https://openreview.net/forum?id=bzxlOyjWbU), GitHub repo (https://github.com/josh-ashkinaze/deep-value-benchmark-neurips)