OpenAI właśnie dorzuciło do Codex nową funkcję o nazwie Auto-review. Zamiast zmuszać cię do klikania „tak” przy każdej operacji wykraczającej poza piaskownicę, teraz robi to za ciebie drugi, wyspecjalizowany agent. Sesje przestają się zacinać w oczekiwaniu na twoją zgodę nawet 200 razy rzadziej, a poziom bezpieczeństwa wciąż zadowala wewnętrzne zespoły OpenAI, które słyną z dość restrykcyjnego podejścia.

TL;DR

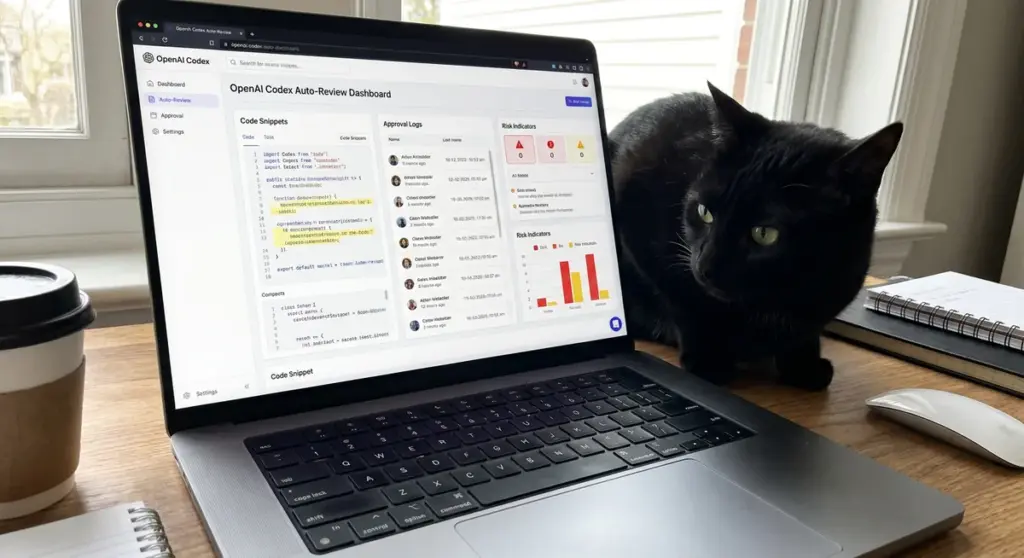

- Auto-review zastępuje ręczne zatwierdzenia recenzją wykonywaną przez oddzielnego agenta AI

- Sesje Codex trwają 200 razy dłużej bez przerw, przy 99,1% automatycznych zatwierdzeń

- Recenzent korzysta z modelu GPT-5.4 Thinking i blokuje m.in. wycieki danych czy obce skrypty

- Funkcja jest już używana wewnętrznie w OpenAI i trafiła jako open source do repozytorium Codex

- To wyraźny krok w stronę agentów, którzy pracują jak zaufani ludzie – bez ciągłego nadzoru

Trzy tryby Codex – od ręcznego sterowania po niemal pełną autonomię

Do tej pory użytkownicy Codex musieli wybierać między dżumą a cholerą. W trybie domyślnym agent co chwilę zawracał głowę prośbą o zgodę na wyjście poza sandbox, co przy dłuższych zadaniach potrafiło doprowadzić do szewskiej pasji. Z kolei tryb Full Access zdejmował wszelkie kagańce, ale przy okazji wyrzucał przez okno jakiekolwiek poczucie bezpieczeństwa. Auto-review wprowadza trzecią drogę: główny agent proponuje akcję, a oddzielny recenzent ocenia ją przez pryzmat intencji użytkownika i polityki bezpieczeństwa.

Dzięki takiemu podejściu większość rutynowych operacji, jak edycja plików w konkretnym folderze czy lokalne komendy, przechodzi bez zbędnych przestojów. Pod lupę trafiają tylko faktyczne eskalacje, czyli próby połączenia z siecią, uruchomienie niezaufanego skryptu czy dostęp do wrażliwych danych. OpenAI twierdzi, że w praktyce Codex przerywa pracę, by zapytać człowieka o zdanie, aż 200 razy rzadziej niż w trybie domyślnym.

| Tryb | Częstotliwość zatwierdzeń | Poziom bezpieczeństwa | Przeznaczony dla |

|---|---|---|---|

| Default | Wysoka (częste przerwania) | Wysokie (ścisły sandbox) | Użytkownicy wymagający pełnej kontroli |

| Full Access | Brak | Niskie (brak egzekucji reguł) | Szybkie eksperymenty i testy |

| Auto-review | Niska (200x mniej) | Wysokie (recenzja przez agenta) | Długie, autonomiczne zadania |

Moim zdaniem to nie jest tylko kosmetyczna poprawka interfejsu, ale zmiana architektury, która uderza w najsłabsze ogniwo dzisiejszych agentów: ograniczoną uwagę człowieka. Zamiast być niańką dla bota, stajemy się menedżerem, który wkracza tylko w sytuacjach kryzysowych.

Jak działa strażnik? Separacja ról zamiast jednej wielkiej sieci neuronowej

Główny agent Codex jest zaprogramowany na dowożenie wyników – chce wykonać zadanie jak najszybciej, czasem idąc na skróty. Recenzent ma zupełnie inną rolę: sprawdza, czy te skróty nie prowadzą nad przepaść i czy akcja nie narusza granic środowiska pracy. Taka separacja ról sprawia, że model wykonawczy nie czuje presji, by „oszukać” system ograniczeń. 99,1% eskalacji jest zatwierdzanych automatycznie, co potwierdzają dane z wewnętrznego ruchu OpenAI z marca 2026.

Recenzent opiera się na modelu GPT-5.4 Thinking w wersji zoptymalizowanej pod kątem szybkości. OpenAI sprawdzało też potężniejsze warianty, które lepiej wyłapują niuanse, ale działo się to kosztem zbyt dużych opóźnień. Co ciekawe, gdy recenzent odrzuci akcję i poda uzasadnienie, Codex w ponad połowie przypadków potrafi sam znaleźć bezpieczniejszą ścieżkę i kontynuować pracę bez angażowania dewelopera.

Cała funkcja trafiła już do repozytorium Codex na GitHubie jako open source. Oznacza to, że każdy może ją wdrożyć we własnych procesach, nie czekając na oficjalne wdrożenia w komercyjnych narzędziach. To rzadki przypadek, gdy gigant z San Francisco tak szybko dzieli się konkretnym mechanizmem kontrolnym ze społecznością.

Auto-review is a new mode that lets Codex work longer with fewer approvals and safer execution.

It helps Codex keep moving through tests, builds, and more, including during long tasks and automations, while a separate agent checks higher-risk steps in context before they run. pic.twitter.com/TCcNC5yB0H

— OpenAI Developers (@OpenAIDevs) April 23, 2026

Co to zmienia dla deweloperów i jak na to odpowiada konkurencja?

Wielogodzinne migracje czy budowanie skomplikowanych testów stają się wreszcie możliwe bez konieczności gapienia się w terminal. W OpenAI większość pracowników korzysta już z Codex Desktop właśnie w trybie Auto-review. Zarówno zespoły od bezpieczeństwa, jak i badacze ceniący płynność pracy, dają temu rozwiązaniu zielone światło. To narzędzie, które przeszło solidne testy zespołów atakujących, więc nie mówimy tu o marketingowej wydmuszce.

Jeśli spojrzymy na konkurencję, Anthropic w swoim Claude Code również postawiło na automatyczną recenzję, ale tam skupia się ona głównie na sprawdzaniu gotowego kodu po fakcie. OpenAI idzie o krok dalej: recenzja odbywa się w locie, zanim agent w ogóle zdąży nabroić. Jak Anthropic zaimplementowało automatyczną recenzję w Claude Code pokazuje, że branża widzi ten sam problem, choć każdy próbuje go ugryźć z innej strony.

OpenAI stawia sprawę jasno: Auto-review to tylko przystanek. Celem jest stworzenie agenta, któremu będziemy ufać tak samo, jak doświadczonemu pracownikowi. Na ten moment to rozsądny kompromis między sztywnym, bezpiecznym więzieniem a pełną samowolką AI. Skoro kod jest otwarty, programiści mogą teraz sami dokręcać śruby w tym mechanizmie, dostosowując go do własnych standardów bezpieczeństwa.

Źródła:

alignment.openai.com/auto-review/, x.com/OpenAIDevs/status/2047436655863464011, blockchain.news/ainews/openai-codex-auto-review-launch-guardian-agent-cuts-human-approvals-and-boosts-safer-automation, zeronoise.ai/agents/ai-news-digest-guiipx1qk6, developers.openai.com/codex/changelog, github.com/openai/codex